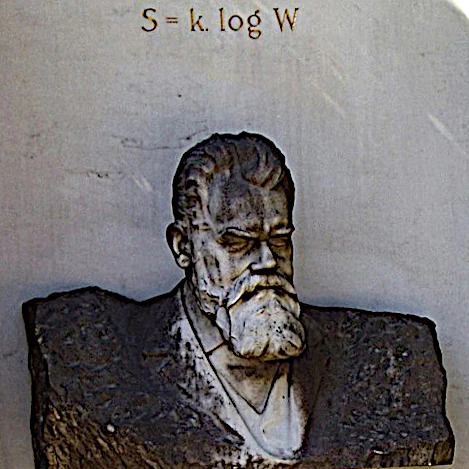

La Ecuación de la Entropía fue desarrollada por el físico austriaco Ludwig Boltzmann. La entropía (S) es un concepto poderoso que mide el desorden o la incertidumbre de un sistema físico.

La ecuación de la entropía de Boltzmann es esencial para comprender la relación entre la entropía y las propiedades termodinámicas de un sistema, como la temperatura, la presión y la energía. Juega un papel crucial en el estudio de los procesos de equilibrio termodinámico, la evolución de los sistemas físicos y la interpretación estadística de las leyes de la termodinámica.

La ecuación de la entropía de Boltzmann generalmente se expresa de la siguiente manera: S = k log(W)

Esta ecuación muestra que la entropía es proporcional al logaritmo del número de microestados posibles del sistema.

Un sistema se dice que tiene una entropía alta si puede existir en un gran número de microestados desordenados (más desorden), mientras que un sistema con pocos microestados accesibles tendrá una entropía más baja (más orden).

El logaritmo transforma valores grandes en valores más pequeños, lo que facilita ciertos cálculos en física y matemáticas. Si usáramos ���� directamente en la ecuación de Boltzmann, obtendríamos valores de entropía enormes y difíciles de interpretar. El logaritmo sirve para hacer estos valores más manejables y respetar propiedades matemáticas esenciales, como la aditividad de la entropía. En resumen, aunque un logaritmo es "mucho más pequeño," nos da una escala más práctica para razonar sobre sistemas donde los números de microestados son gigantescos. ¡Es un poco como medir distancias astronómicas en años luz en lugar de kilómetros!

La ecuación de Boltzmann no llevó directamente al descubrimiento del átomo, pero jugó un papel crucial en la comprensión teórica de la naturaleza atómica de la materia y en el desarrollo de la física estadística, que confirmó la existencia de los átomos.

S = klog(W) relaciona el comportamiento microscópico (movimiento de los átomos) con las propiedades macroscópicas (presión, temperatura, entropía).

La entropía es un concepto fundamental utilizado en diversas áreas de la ciencia, incluyendo termodinámica, mecánica estadística, teoría de la información, informática, ciencias de la complejidad y otros campos.

La definición de entropía puede variar ligeramente según el contexto, pero comparte ideas comunes en estos campos.

En todos los casos, la entropía es una medida de la cantidad de información, desorden, diversidad o incertidumbre en un sistema.

Sin embargo, en el universo, observamos estructuras cada vez más ordenadas que se forman a partir de procesos inicialmente menos organizados. Esto parece ir en contra de la idea intuitiva de que la entropía, como medida del desorden, debe aumentar siempre, como sugiere el segundo principio de la termodinámica.

El aumento del orden local (como la formación de galaxias y estrellas) no implica una violación del segundo principio de la termodinámica. Este principio se aplica al sistema completo y establece que la entropía total de un sistema aislado, el Universo, no puede disminuir con el tiempo.

Cuando observamos la formación de galaxias y estrellas, debemos considerar todo el sistema, incluyendo la energía y los procesos involucrados a gran escala. Así, lo que puede parecer una disminución del desorden a pequeña escala es en realidad una simple redistribución de la energía y la entropía a una escala mayor.

Las estructuras que emergen en el Universo no son anomalías, sino manifestaciones de procesos físicos fundamentales, donde la organización local siempre va acompañada de la disipación de energía en otro lugar.

La disipación de energía ocurre principalmente en forma de radiación térmica. Cuando una estructura ordenada se forma localmente, como una estrella o una galaxia, el sistema global aumenta su entropía, por ejemplo:

En resumen, el Universo equilibra la creación de estructuras ordenadas redistribuyendo energía en forma de radiación y otros procesos disipativos, asegurando que el segundo principio de la termodinámica siempre se respete. Lejos de ser una ilusión, este orden aparente es una faceta natural del caos cósmico.